AI应用开发不再烧脑,天玑Neuron Studio全链路赋能开发者体验

2025-04-11 17:15:08爱云资讯9224

从2024年到2025年,AI技术正在突破实验室边界,加速落地用户场景,成为改变人机交互范式的关键引擎。近日,联发科举办的天玑开发者大会2025(MDDC 2025)以“AI随芯,应用无界”为主题,集结全球开发者、终端大厂及产业链合作伙伴,被誉为“AI生态春晚”。会上,联发科提出“智能体化用户体验”的愿景,并正式启动“天玑智能体化体验领航计划”,同时一口气发布三大AI重磅产品:天玑开发工具集与AI开发套件2.0、全新升级的天玑星速引擎,以及旗舰5G AI芯片天玑9400+,实现从芯片、模型到工具的全链路能力开放。

大会上,联发科定义了“智能体化用户体验”的五大特征:主动及时、知你懂你、互动协作、学习进化和专属隐私信息守护。这五大特征需要跨越从芯片、模型、应用、终端乃至整个生态系统的系统性革新,更需要高效、强力的开发者解决方案。为此,联发科带来了一站式可视化智能开发工具——天玑开发工具集,包含AI应用全流程开发工具Neuron Studio,并带来全新升级的天玑AI开发套件2.0,打造了一整套围绕AI开发效率与落地路径展开的“系统性解法”,为开发者提供了AI应用开发工具全家桶。同时,全新升级的旗舰5G智能体AI芯片天玑9400+也为智能体化用户体验提供了牢固的算力基石。

Neuron Studio打造全流程一站式开发体验,为AI应用开发按下加速键

AI 应用的开发瓶颈,从来都不是“点的问题”,而是“链的问题”:开发工具碎片化,调优过程靠手动,单模型分析效率低,成为开发者最头疼的三大痛点。在Neutron Studio出现之前,AI应用开发往往意味着多个工具链的反复切换,兼容适配问题频发,开发效率大打折扣。

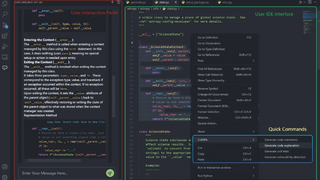

而联发科的AI应用全流程开发工具Neuron Studio提供了最优解。Neuron Studio可针对模型到应用,提供一站式、全链路、自动化的开发协助,不仅让AI应用开发的全流程可视化,更带来整个多种工具的一站式开发能力,还支持神经网络自动化调优和跨模型全链路分析功能,针对AI应用开发的三大痛点逐个击破。

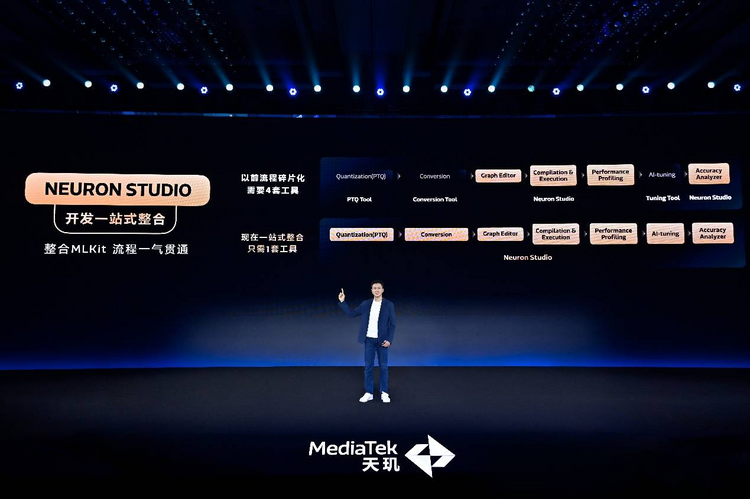

当前AI应用开发者在使用开发工具时会面临一个很头疼的问题,种类多、功能不聚合、过于碎片化,导致开发过程非常复杂。Neuron Studio整合了多个MLKits工具,包含模型转换、模型量化和模型调优,将关键模块融合成一站式、可视化的完整开发链路,开发者不再需要“拼积木式”组合多个工具,只用一套工具就可以已全部搞定,极大提升开发效率。

Neuron Studio 还支持自动化调优神经网络使用的带宽及性能,在开发过程中,将性能和内存占用自动优化至最佳配置。而且,开发者可以全程监控大模型演化过程。以前万组参数手动调优动辄需要一周,而现在只要几个小时即可完成。

此外,Neuron Studio打造了跨模型全链路分析功能,提供全局视角和执行流程。开发者不在需要针对大模型中不同模块各自独立分析,实现“全局视角、一站掌控”,大幅节省模型分析时间。

这不仅仅是工具的升级,更是迈向智能体化用户体验的关键基础设施。

天玑AI开发套件 2.0,全面释放天玑端侧AI能力

去年,天玑AI开发套件一经发布就广受开发者好评和推荐。在MDDC 2025上,联发科带来了全面升级的天玑AI开发套件2.0,在模型库规模、架构开放程度、前沿端侧AI技术支持和端侧LoRA训练落地等方面均迎来全面跃迁,为开发者提供了更全面、更开放、更强大的端侧AI开发解决方案。

端侧AI应用开发往往需要调用各种各样的大模型能力,需要更丰富、类型更多的模型适配。为此,Gen-AI Model Hub全面扩容,模型数量在原有基础上激增了3.3倍,并支持DeepSeek-R1蒸馏模型、通义千问、混元等多种先进端侧大模型,还包含视觉、语言、多模态等多种多样的大模型,开发者可以通过Gen-AI Model Hub一键调用模型能力,让AI应用开发选择更丰富。

为了让开发者免受即有模型库的限制,联发科还首发了开源弹性架构。区别于过往的开放接口,只能部署特定架构模型,开放弹性架构允许开发者直接调整平台源代码,无需等待芯片厂商的支持,即可完成目标或其他自研大模型轻松部署。让AI应用开发不用“等平台”,彻底释放开发效率和模型接入自由度。

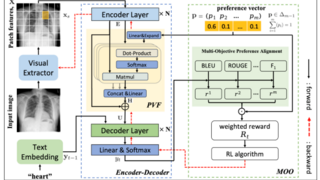

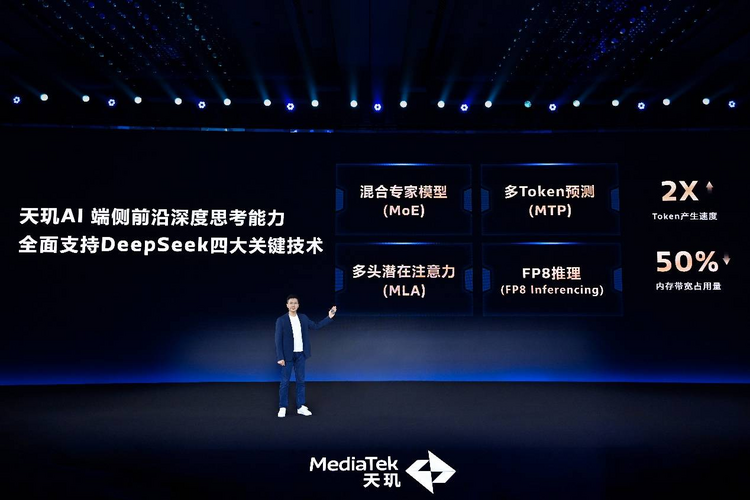

自DeepSeek横空出世以来,这种更适合端侧部署,回答效率更高效的训练模式快速引爆了AI行业,主流大模型纷纷加强了推理能力。天玑AI开发套件2.0全面支持 DeepSeek四大关键技术:混合专家模型(MoE)、多Token预测(MTP)多头潜在注意力(MLA)、FP8推理(FP8 Inferencing),实现Token产生速度提升2倍以上、内存带宽占用量大幅度降低50%,让端侧AI推理更聪明、响应更迅速。

天玑AI开发套件2.0还首次引入基于NPU的端侧LoRA训练,开发者在天玑NPU上进行运算训练,相比基于CPU的训练方案,训练速度猛增50倍,将训练时间从一整天缩短至半小时。更快的端侧LoRA训练,让端侧AI基于用户端侧数据提升个性化体验,让终端成为更懂用户的个性化智慧伙伴。

智能体用户体验的进化,从生态整合与携手跃迁开始

本次MDDC 2025,联发科不仅带来了更加强大、全面的开发者解决方案,更展示了不断拓展的天玑AI生态。从去年MDDC 2024之后,天玑AI生态伙伴数量大幅增长了3倍,天玑AI开发套件下载量也同比增长5倍,可见天玑的AI开发者解决方案已经被开发者高度认可,天玑AI生态圈正在飞速成长起来。

联发科与OPPO深度合作,共同研发,借助天玑AI开发套件中支持DeepSeek的四大关键技术,快速实现MoE技术的端侧部署,Token产生速度提升了40%,让端侧大模型拥有更高的计算效率和推理性能,使端侧AI交互响应更及时,用户体验更贴心。

联发科还与vivo和全民K歌携手,借助天玑AI人声萃取技术,大幅提升录音人声质量,将vivo X200s打造成安卓首款K歌旗舰手机,并获得臻品录音Pro级认证,给用户带来一款录音室级的K歌神器。

基于天玑AI开发套件的开源弹性架构,联发科还与美图合作完成美图自研PIX GP模型的整合,并且针对模型进行全链路微秒级分析,以确保最佳的端到端性能表现。在双方的整个合作流程中,开发效率提升了30%。

天玑AI生态同样拓展到了智能座舱领域。联发科和绝影合作,快速完成了绝影的自有模型移植,使首字词生态速度比云端方案提升70%,赋能绝影多模态智能座舱强大的端侧运行能力,让汽车拥有“有趣的灵魂”。

不仅如此,天玑AI开发套件已经接入NVIDIA TAO生态圈,实现TAO生态和天玑AI生态的全面打通。这意味着,天玑开发者将有机会获取更多NVIDIA TAO生态的AI开发资源,TAO生态开发者可将开发成果轻松移植到天玑各类端侧平台,实现一次开发,全域应用的生态破圈。两大AI巨头强强联手,势必为智能体化AI体验时代按下超级加速键。

站在AI从“技术爆发期”走向“体验普及期”的关键转折点,联发科正从芯片为底、工具为桥、生态为核,打通“芯片-模型-工具-终端”的全栈路径。从智能手机到智能座舱,开发工具到体验落地,天玑平台正成为智能体化体验的加速器。AI生态进入规模化部署阶段,以联发科为代表的技术平台方,正释放“硅基智能体”真正潜能,让AI体验从尝鲜走向刚需,从概念走向日常。

相关文章

- AI应用开发不再烧脑,天玑Neuron Studio全链路赋能开发者体验

- 联发科召开天玑开发者大会2025,让AI体验从新奇到好用

- 3月安兔兔榜出炉,天玑9400登顶,天玑9400+本月将至

- 联发科天玑开发者大会2025将于4月11日召开,报名通道开启!

- 中科天玑新产品全要素AI舆情系统正式上线,重新定义舆情管理的价值边界

- 手机AI性能全面升级,天玑9400霸榜苏黎世,打造极致AI体验

- 天玑8400-Ultra芯片上机,REDMI Turbo 4给出满帧游戏体验

- 旗舰级GPU加持!REDMI Turbo 4用天玑8400-Ultra游戏满帧低功耗

- 天玑8400-Ultra神U加持,REDMI Turbo 4重新定义同级标杆

- 强芯驱动,REDMI Turbo 4采用天玑8400-Ultra打破性能天花板

- 天玑8400-Ultra强势登场:REDMI Turbo 4搭载,性能秒杀同级

- ETHZ AI性能评测结果:天玑 9400 AI性能领先同级竞品

- 天玑9400 AI性能超越一众旗舰芯片,称霸AI Benchmark排行榜!

- 《英雄联盟手游》携手联发科合作实现支持天玑星速引擎,高帧稳帧体验劲爽!

- 天玑8400支持AI作曲家应用,任你随弹即刻成曲

- 全大核天玑8400硬刚旗舰,寒假手游开黑、旅行拍照就选它!