深度整合通义万相2.1 + ComfyUI,RunningHub打造零门槛AI视频生产力平台

2025-03-05 15:29:13爱云资讯99849

2025年2月25日,阿里云正式开源视觉生成基座模型万相2.1(Wan),这一重磅动作在AI视频生成领域掀起技术浪潮。作为全球率先实现万相2.1全功能整合的在线AIGC创作平台,RunningHub以“零门槛、高性能、全生态”的优势,让创作者零门槛驾驭尖端AI技术。

万相2.1:超越Sora的国产大模型

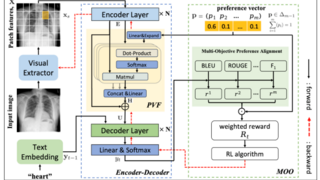

作为阿里云视觉生成技术的集大成者,14B版本的万相模型在指令遵循、复杂运动生成、物理建模、文字视频生成等方面表现突出,1.3B版本测试结果不仅超过了更大尺寸的开源模型,甚至还接近部分闭源模型。

在权威评测集VBench中,万相2.1以总分86.22%的成绩大幅超越Sora、Luma、Pika等国内外模型,稳居榜首位置,尤其在复杂运动生成(如人物旋转、跳跃)、物理规律模拟(碰撞、反弹)和中文文字视频生成上表现惊艳。

RunningHub:万相2.1的最佳拍档

面对14B参数模型对本地部署带来的挑战,作为AI创作领域的先锋,RunningHub 率先集成万相2.1模型,用户无需复杂的本地部署,一键即可调用万相2.1模型。

针对14B模型的高算力需求,RunningHub依托超大规模云端GPU集群,提供流畅的在线生成体验,彻底解放本地硬件压力。无论是专业创作者还是新人小白,都能通过网页端高效创作专业级视频。

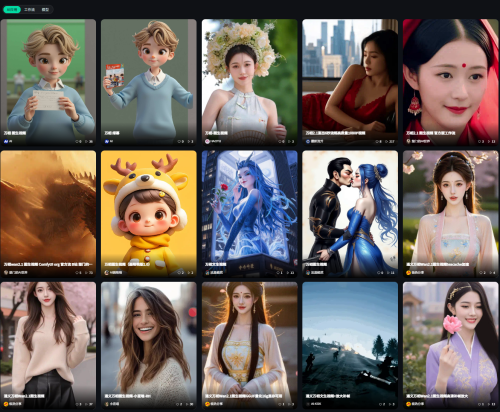

作为最受全球创作者欢迎的在线AIGC创作平台,RunningHub集成Stable Diffusion、Lora等超6000+节点与海量模型,覆盖游戏、动漫、电商、设计等多个创作领域,结合万相2.1的强大能力,能够轻松打造多样化内容。

目前,已有多名创作者通过RunningHub万相2.1打造出数十个专业工作流及AI应用。

万相2.1的开源标志着AI视频技术商业化的加速,而RunningHub的深度整合让这一技术触手可及,当万相2.1遇见RunningHub的云端生态,技术门槛不再是创意的枷锁。无论是想用AI快速生成产品演示视频的电商团队,还是试图用动态漫画讲述故事的独立创作者,现在只需打开浏览器就能调用对标好莱坞特效的生成能力,将创意快速转化为作品。

立即加入RunningHub,成为首批驾驭万相2.1的先锋创作者!在这里,每一份灵感都能被AI赋能,每一秒视频都在定义未来。

相关文章

- 通义灵码携 Qwen2.5-Max 震撼登场,编程能力问鼎榜首

- 免费不限量、免部署,通义灵码支持DeepSeek-V3 和 DeepSeek-R1 满血版

- 插件下载量破千万,通义灵码再放大招,开放支持DeepSeek-V3和R1满血模型

- 通义灵码全新上线模型选择功能,新增支持 DeepSeek-V3 和 DeepSeek-R1 满血版模型

- 阿里云通义智能语音技术助力听力熊打造领先的AI智能终端——用大模型陪伴青少年学习成长|看见新力量NO.139

- RTE2024 AI 专场开启 通义千问、MiniMax、智谱、Soul来了

- 钉钉接入通义听悟技术,实现智能区分会议室里不同发言人

- 全球最强开源模型!阿里通义千问登顶国内第一:超越一众开闭源

- 通义千问新版本发布超越GPT-4-Turbo,微软/微美全息构建多模态AI生产力领先业界

- ChatGPT、Gemini、通义千问等一众大语言模型,哪家更适合您?

- 小米SU7引爆北京车展,车企纷纷“上车”通义大模型

- MTK携手阿里云 完成通义千问天玑平台端侧部署

- 免费开放1000万字长文档处理功能,阿里通义千问文档能力超越ChatGPT

- 阿里巴巴CEO吴泳铭:通义千问正加快追赶 GPT-4

- 接入“通义千问”等大模型,蓝凌加速打造AI时代最好用办公平台

- 阿里云将开放“通义千问”,为每家企业打造专属GPT