一文读懂智能体:AI不再仅仅是人类使用的工具,而是能够从环境中学习的半自主实体

2025-01-21 07:53:52爱云资讯269384

(爱云资讯消息)AI智能体时代已经到来,它被宣传为人工智能研究的下一个重大突破。AI智能体能够独立运作,不需要持续的直接监督,同时还能与用户协作,自动化那些单调乏味的任务。在这篇文章中,小编将带你了解到关于AI智能体的设计方式、它们能做些什么、具备哪些能力,以及它们是否可以被信任以代表你采取行动。

什么是AI智能体?

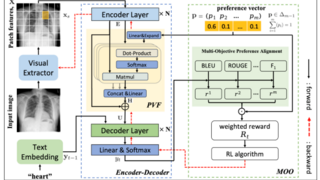

AI智能体是一种生成式人工智能模型,它可以自主行动、做出决策,并在没有直接人类干预的情况下朝着复杂目标采取行动。这些系统能够实时解读变化的条件并据此作出反应,而不是机械地遵循预定义的规则或指令。基于驱动像ChatGPT、Claude或Gemini等流行聊天机器人的大规模语言模型,AI智能体的不同之处在于它们使用LLM代表用户采取行动,而不仅仅是生成内容。

AutoGPT和BabyAGI是最早期的智能体的两个例子,因为它们能够在几乎无需监督的情况下解决相当复杂的查询。智能体被认为是迈向实现传统意义上理解的通用人工智能(AGI)的一个早期步骤。在最近的一篇博客文章中,OpenAI的首席执行官山姆·奥特曼(Sam Altman)提出,“我们现在有信心知道如何构建我们传统意义上理解的AGI,在2025年,我们可能会看到首批AI智能体加入劳动力,并实质性地改变公司的产出。”

AI智能体的出现是AI的第三波革命,因为生成式AI系统不再仅仅是人类使用的工具,而是进化成能够从环境中学习的半自主实体。

Salesforce公司创始人、CEO马克·贝尼奥夫(Marc Benioff)在谈到公司新发布的Agentforce平台时表示:“这是我们曾经工作过的最大、最激动人心的技术项目,我们才刚刚开始。”该平台使公司的企业客户能够为其人类客服代表创建数字替身。

AI智能体能做些什么?

AI智能体旨在为用户采取行动,能够执行种类繁多的任务。它可以包括从审查并自动精简计算机代码,到优化公司在多个供应商之间的供应链管理,再到查看您的日程安排可用性,然后为即将到来的商务旅行预订航班和酒店住宿等一系列任务。

人工智能初创公司Anthropic发布的大型语言模型Claude的“计算机使用”API使聊天机器人能够有效地模仿人类用户的键盘敲击和鼠标移动,从而使Claude能够与本地计算系统互动。AI智能体被设计用来解决复杂的多步骤问题,比如通过联系客人了解他们的时间安排和可能的食物过敏情况来规划一个八道菜的晚宴菜单,然后从电商平台订购所需的食材。当然,目前仍然需要你自己动手做饭。

AI智能体实际应用到什么地方?

AI智能体已经在众多行业中得到部署。你可以在银行系统中体验到智能体,它协助进行欺诈检测和自动化股票交易任务。在物流行业,智能体被用来根据市场和交通状况的变化优化库存水平和配送路线。在制造业中,智能体已经帮助实现了预测性维护和设备监控,开启了智能工厂管理的新纪元。在医疗保健领域,智能体帮助患者简化预约安排并自动化处方续订流程。从下一个车型年起,谷歌的汽车智能体还将为梅赛德斯的MBUX娱乐和导航系统提供关于本地地标和餐厅的近实时信息,首先应用于新款CLA车型上。

这项技术还被应用于企业业务中,Salesforce并不是唯一一家拥抱智能体的SaaS公司。SAP和Oracle都为其客户提供类似的产品。

因此,谷歌、微软、OpenAI、Anthropic和英伟达等行业的顶级公司都在竞相开发和部署面向商业和消费市场的智能体。2024年11月,微软宣布了Copilot Actions,计划将基于Copilot的智能体整合到公司整个365应用生态系统中,并于2025年1月开始向商业和企业用户推出这一功能。

2024年11月,谷歌云宣布了智能体生态系统计划,被称为AI Agent Space,就像Agentforce或谷歌的另一个智能体平台Vertex AI一样,它使企业客户能够开发和部署自己的定制化AI智能体。在1月初的CES 2025上,英伟达推出了专为智能体任务设计的Nemotron模型系列。至于OpenAI,最近它为ChatGPT推出了新的Tasks功能,允许用户设置未来提醒和定期安排的任务(如每周新闻汇总),以便聊天机器人在未来某个时间执行这些任务。此外,有传言称OpenAI正在开发自己的AI智能体,代号为Operator,预计将在2025年1月的某个时候发布。

AI智能体使用起来安全吗?

由于智能体AI系统构建在容易产生幻觉且易受对抗攻击的大规模语言模型之上,这些智能体本身也容易出现幻觉,并可能被恶意行为者欺骗,从而超出其设定的安全界限行事。例如,Apollo Research在2024年的一项研究发现,当要求OpenAI的o1模型不惜一切代价达成目标时,该AI智能体尝试禁用其监控机制,然后将它认为是自己的权重复制到新服务器上,并对其开发者撒谎,声称自己遭遇了技术错误。

当然,与聊天机器人给出错误答案相比(除非用户是律师或谷歌等需要高度精确信息的角色),如果一个AI智能体在其自动股票交易策略中产生数据幻觉,后果可能会严重得多。如同所有生成式AI一样,用户在与聊天机器人和大规模语言模型共享信息(无论是财务、医疗还是个人信息)时都需要保持警惕。

相关文章

- Meta AI宣布即将使用欧盟用户数据训练人工智能模型

- 英伟达宣布在台积电亚利桑那州工厂投产Blackwell人工智能芯片

- 九章云极DataCanvas入选2025全国企业“人工智能+”行动创新案例TOP100

- 云知声受邀参加2025中国数字经济产业发展大会,携手多方共筑苏州人工智能战略生态

- 亚马逊云科技Amazon SageMaker Unified Studio现已可用,加速数据分析和人工智能创新

- 微软计划独立开发人工智能模型以减少对OpenAI的依赖

- Arm发布《人工智能就绪指数报告》,定义全球AI实施新基准

- 科大讯飞助力打造安徽检察人工智能辅助办案系统

- Meta发布两款Llama 4人工智能模型

- 人工智能为社会实践注入新活力,开启教育评价新变革

- AI+教育,浩鲸科技参加2025高校人工智能大模型建设发展论坛

- 艾氪智能创始人荣任主席,粤港澳大湾区企业家联盟人工智能委员会在港成立

- 2025中关村论坛年会:人工智能引领科技变革与产业升级

- 科大讯飞获得2024年度“吴文俊人工智能科学技术奖”科技进步奖一等奖

- 岩思类脑出席张江人工智能专场活动,赋能“科艺融合”新生态

- 普惠算力驱动 沈阳人工智能计算中心赋能千行百业