昇思多维混合分布式并行技术,助力伙伴快速复现Llama 3.1-405B大模型

2024-09-10 11:13:15爱云资讯103117

摘要:10倍级调优效率、分钟级任务恢复!昇思助力千亿模型快稳训练

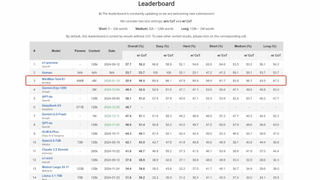

基于昇腾AI大集群,运营商伙伴基于昇思MindSpore AI框架成功实现了Llama3.1-405B大模型的训练。数据显示,本次模型训练性能与原生方案持平,训练效率及稳定性显著提升,展示了昇腾AI处理器与昇思AI框架软硬结合的强大能力。

本次联合创新,是运营商伙伴联合昇思首次在超大规模集群上,快速打造基于昇思MindSpore版本的开源千亿稠密大模型,且实现适配后模型原生、训练效率提升。

根据公开报道,Llama3.1-405B原生训练耗时持续54天,累计发生419次故障,平均每3小时产生一次,模型训练耗时长、稳定性要求高,如何优化训练性能、提升执行效率,同时提升稳定性,成为加速模型训练、提升模型精度的关键。面向训得快、训得稳等需求,昇思MindSpore提供了大模型开发套件、多维混合分布式并行、断点续训等能力,支持Llama3.1-405B又快又稳训练。

一、10倍级调优效率提升,任务拉起快、分布式配置策略便捷

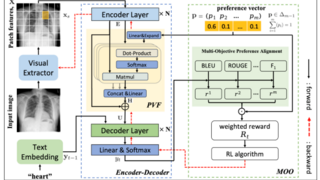

MindSpore Transformers大模型开发套件支持一键YAML配置多维并行切分策略,使用开发的套件的训练组件,相较业界其他产品更简洁易用,快速在超大集群上拉起千亿稠密模型任务,提升计算的调度效率。

同时,套件封装轻量接口调用分布式并行接口,使用数据并行、模型并行、流水线并行、细粒度多副本并行、序列并行等多种策略混合,配合offset参数调整模型切分策略,实现模型切分的计算与内存负载均衡,解决内存瓶颈问题,最大化昇腾硬件性能释放,结合LazyInline等特性,提升内存复用效率。此外,依托计算通信多流水并行、运行时流水异步调度,算子融合等多种加速优化特性,进一步提升模型性能。

此外,MindSpore的内存复用技术进一步优化了资源使用,降低了重复计算的比例,使得大规模训练更加高效。

模型的调试调优依托MindSpore提供的Dryrun模拟功能,实现单卡仿真集群分布式策略选择。训练时在离线的单卡场景进行模型训练的内存瓶颈分析、并行策略调优,无需占用超大集群,并将单卡模拟的分布式策略直接映射到超大集群应用,在小时级时间尺度上调试出接近极致性能的405B并行策略配置,相对于传统的大集群上直接调优,效率提升10倍以上,同时,降低开发者选择分布式并行策略门槛,节省大量硬件资源及时间成本。

二、20分钟内实现任务恢复:断点续训与编译缓存技术

面对千亿参数模型在超大集群的频繁中断问题,昇思MindSpore通过编译缓存技术,打造确定性CKPT,支持断点续训,以小时级颗粒度进行任务保存,减少中断时训练进度的丢失。断点续训显著缩短了故障情况下任务重新拉起的耗时,断点续训自故障发生至新训练出loss时间跨度缩至20分钟内,大幅减少了长时间任务中断后重新启动的等待时间。

未来,昇思MindSpore将携手更多伙伴,在自主创新的软硬件基础平台上,原生孵化、适配支持更多全球范围的主流模型,加速使能大模型创新,推动AI应用落地。

相关文章

- 云从科技出席昇思人工智能框架峰会 发布原生大模型成果

- 昇思开源4年份额达30%,使能超50主流大模型

- 途普科技企业知识中台完成华为昇思MindSpore技术认证

- 昇思多维混合分布式并行技术,助力伙伴快速复现Llama 3.1-405B大模型

- 加速原生创新,智谱携手昇腾、昇思打造自主创新原生模型

- 昇腾与昇思原生,助力智谱打造自主创新大模型体系!

- 昇思人工智能框架峰会2024圆满落幕|软通动力大模型一体机发布

- 昇思MindSpore 2.3全新发布 | 昇思人工智能框架峰会2024圆满举办

- WAIC亮点直击:昇思MindSpore展区引领AI技术创新

- 昇思MindSpore:人工智能的创新之源

- 华为推出首个开源云原生AI卫星应用方案 昇思MindSpore积极赋能

- 昇思MindSpore1.6发布 AI开发者体验再升级