阿里云机器学习平台PAI与华东师范大学论文入选SIGIR 2022

2022-07-12 10:33:41爱云资讯982

近日,阿里云机器学习平台PAI与华东师范大学高明教授团队合作的论文《结构感知的稀疏注意力Transformer模型SASA》被顶会 SIGIR 2022录取。论文主导通过引入稀疏自注意力的方式来提高Transformer模型处理长序列的效率和性能,并提出了结合代码语言和结构特性的面向长代码序列的Transformer模型性能优化方法。

SIGIR是人工智能领域智能信息检索方向顶级国际会议,涉及搜索引擎、推荐系统等多个方向,该会议曾推动了面向搜索的排序模型、基于深度学习的推荐算法等人工智能领域的核心创新,在学术和工业界都有巨大的影响力。此次入选意味着阿里云机器学习平台PAI自研的稀疏注意力Transformer模型达到了业界先进水平,获得了国际学者的认可,展现了中国机器学习系统技术创新在国际上的竞争力。

那么SASA主要解决了什么问题?基于Transformer的模型在self-attention模块的复杂度随序列长度呈次方增长,多数编程预训练语言模型(Programming-based Pretrained Language Models, PPLM)采用序列截断的方式处理代码序列,从而导致上下文信息缺失。

针对以上问题,SASA设计了四种稀疏注意力模式,包括:sliding window attention,global attention,Top-k attention,AST-aware attention,在一定程度上将计算复杂度与序列长度解耦。其中sliding window和Top-k模式基于局部上下文和重要的attention交互学习表示,抽象语法树(AST)模式引入代码的结构特性,与序列上下文信息相互补足,global attention通过与序列中所有token进行交互来获取全局信息。对比CodeBERT,GraphCodeBERT等方法,SASA在多个长代码任务上取得最佳效果,同时也降低了内存和计算复杂度。

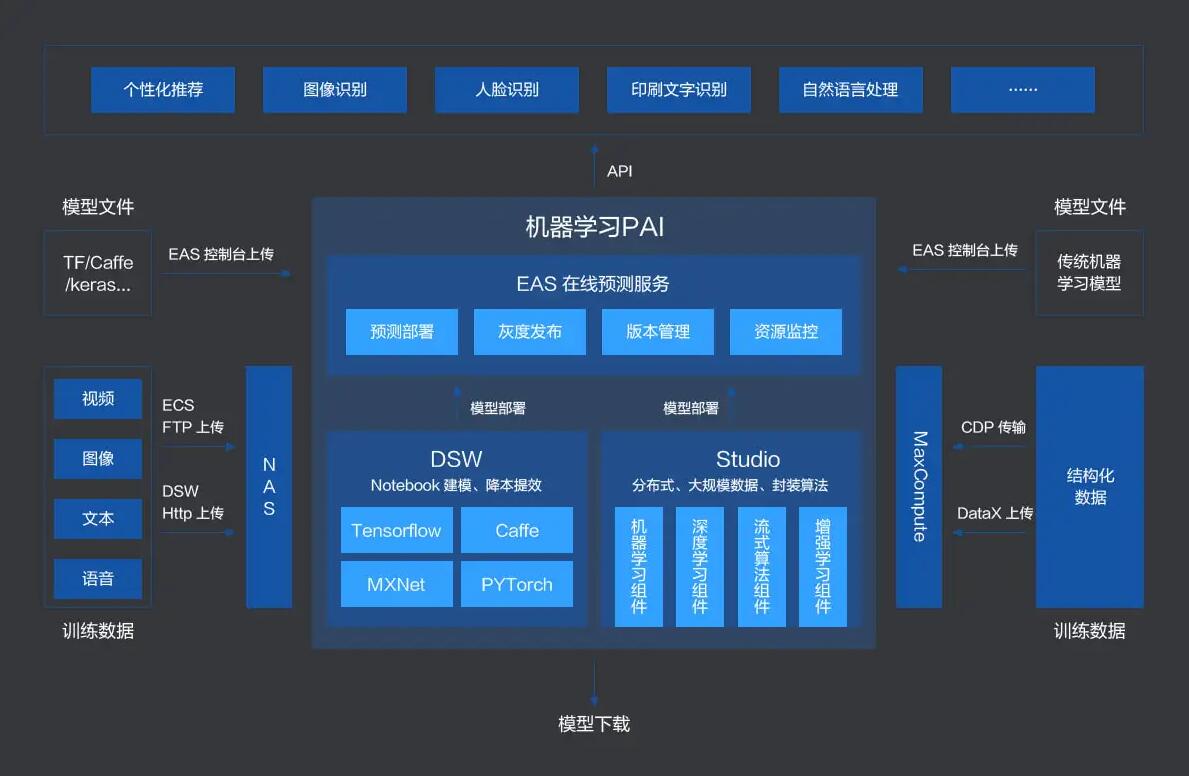

SASA技术将在开源框架EasyNLP中集成,给PAI的NLP开发者提供基于稀疏注意力机制的长序列自然语言处理能力。机器学习平台PAI面向企业客户级开发者,提供轻量化、高性价比的云原生机器学习,涵盖PAI-DSW交互式建模、PAI-Designer可视化建模、PAI-DLC分布式训练到PAI-EAS模型在线部署的全流程。

论文信息

EasyNLP开源地址:https://github.com/alibaba/EasyNLP

论文链接:https://arxiv.org/abs/2205.13730论文名字Understanding Long Programming Languages with Structure-Aware Sparse Attention. SIGIR 2022论文作者刘婷婷,汪诚愚,陈岑,高明,周傲英

相关文章

- 全球最大线上批发商城与线下商城战略合作,阿里云赋能全球贸易AI时代新篇章

- 亚信科技+阿里云 | 大模型协作新突破,让百行千业用上普惠AI !

- 构建创新生态,阿里云“MARS创业者计划”助力企业决胜AI时代

- 聚力出海,共赢增长|阿里云 x Meta 出海沙龙回顾

- 阿里云与南京大学签署校企合作协议,以“云工开物”支持人工智能人才培养与科研创新

- 阿里云升级Premier级别WhatsApp官方商业解决方案提供商,赋能全球企业高效连接20+亿用户

- 叫叫亮相阿里云AI势能TECH DAY:AI为教育插上想象的翅膀

- 重磅发布!亚信科技、阿里云大模型一体机,让百行千业用上普惠AI

- 接入 DeepSeek、联合阿里云,传音AI战略玩出新高度!

- 阿里云 Chat App 打通模型服务, 0代码接入智能体应用

- AI耳机AIxFU来了!基于阿里云通义大模型深度打磨,性能、智能、价格重新定义行业标准

- 变革通话体验,中国移动携手阿里云通义、华为打造“交互通话”新时代

- 阿里云“上云采购季”开启:AI主流大模型直降88%,超200款云产品爆优惠

- 中国移动阿里云和中兴通讯联合打造的能力开放解决方案荣获GSMA GLOMO “Open Gateway挑战奖”

- 阿里云PolarDB重磅发布云原生与Data+AI新特性,打造智能时代数据引擎

- 恺英网络携手阿里云 共探游戏产业新未来