一流科技创始人袁进辉博士参加智源大会,共谈AI系统发展趋势

2021-06-08 16:18:42爱云资讯1024

6月3日下午,一流科技OneFlow深度学习框架创始人袁进辉博士亮相2021北京智源大会“AI系统”分论坛,并发表《为什么我们需要重新设计分布式深度学习框架》主题演讲,和与会观众分享深度学习分布式AI系统设计的心得体会。

AI系统是当前人工智能领域极具现实意义与前瞻性的研究热点之一,在创新方法器件、体系架构、优化加速等方面都取得的相当大的进展。本次智源大会AI系统分论坛围绕这一领域的最新学术研究进展和产业界核心工作的设计与实践展开。论坛由清华大学翟季冬教授主持,清华大学计算机系教授胡事民、MindSpore首席架构师金学峰、谷歌高级软件工程师陈德颢、Facebook研究院贾志豪、阿里云研究员林伟、百度主任架构师胡晓光一同参加。

袁进辉博士表示,近来,大规模预训练模型因其在文本生成等应用上优异的表现而备受关注,但通用深度学习框架无法直接支持此类需求,主要原因是大模型面临严峻的“内存墙”的挑战。通用深度学习框架仅支持数据并行,还不能支持大规模预训练模型所需要的模型并行、流水并行等技术,只有高度定制的专用软件系统(如InsightFace, HugeCTR, Megatron-LM, DeepSpeed等)才能满足需求。如何在通用深度学习框架统一、灵活、高效的支持这些技术挑战成为业界研究热点。由此,重新设计一款分布式深度学习框架就显得很有必要了。

袁进辉博士演讲

一流科技的OneFlow深度学习框架就是袁进辉博士给出的解决方案。OneFlow深度学习框架拥有完全自主知识产权,原生支持超大模型训练,无需深度开发。独创的自动数据模型混合并行、静态调度、去中心化和全链路异步流式执行四大核心技术,使用纯软件技术解决了大数据、大模型、大计算所带来的异构集群分布式横向扩展挑战。

在圆桌论坛环节,在谈及层出不穷的大规模预训练模型给AI系统带来的挑战时,袁进辉博士说:“预训练模型的主要特点是无监督或者弱监督,以前的模型由人工进行数据标注,费事费钱,现在可以用AI模型标注,提高了效率。不过这也意味着训练出来的AI模型数据量级就会更加庞大,更加丰富。而丰富的数据带来的是复杂的规律,模型参数非常大,计算量也非常大,因此预训练模型走向超大模型是个自然的趋势。这也印证了OneFlow从第一行代码开始,就瞄准‘分布式、大模型’的方向是正确的,OneFlow这样的深度学习框架会成为新一代学习框架的代表。”

右一为袁进辉博士

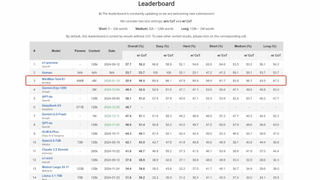

本次智源大会上发布的“悟道2.0”人工智能模型参数规模为1.75万亿,是目前全球最大的模型,比曾经这一领域的“王者”——GPT-3的参数规模大了10倍,而两者发布的时间仅仅相隔一年左右。毫无疑问,瞄准超“大规模、分布式”的OneFlow深度学习框架与袁进辉博士,将在未来有更大的施展空间。

相关文章

- 一流科技创始人袁进辉博士参加智源大会,共谈AI系统发展趋势

- 微软宣布推出对AI系统进行安全测试的自动化工具

- 科学家设计AI系统从无声钢琴演奏视频中再现演奏声音

- 英国研发智能摄像头只传送高级数据 实现高性能、低延迟AI系统

- Facebook推AI系统加快核磁共振(MRI)成像4倍

- AI创企Deep Longevity完成A轮融资 并推出针对衰老相关疾病的全新AI系统

- NVIDIA提供全球最先进AI系统NVIDIA DGX A100帮助对抗COVID-19

- 平安好医生AI系统通过WONCA最高等级认证 满足患者个性化健康需求

- 一分钟测300人,AI系统北京地铁站口测“高温”

- IDC:亚太地区AI系统支出2019年或达55亿美元

- 谷歌部署AI系统“垃圾视频分类器”:净化YouTube主页

- 新品基于海思智能芯片组 华北工控再出两款嵌入式AI系统

- 欧盟发布AI伦理指南 提出未来AI系统应该满足的七项要求

- 欧盟发布人工智能伦理指南:AI系统要负责任且无偏见

- 海信互联网电视激活用户突破4000万,2019全面上线海外VIDAA AI系统

- BAE系统公司投资2000万英镑为海军舰艇开发AR眼镜和AI系统