苹果发布会:iPhone12加量减价了,但最大亮点是人工智能

2020-10-19 14:31:56爱云资讯613

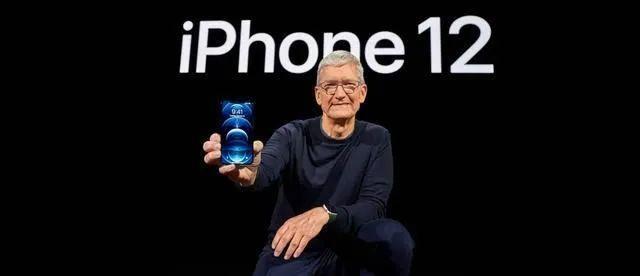

2020年10月14日,距离上次发布会不到一个月,苹果就迎来了秋季的第二场发布会。而这次发布会的主角,就是之前已经被全方位曝光的 iPhone 12 系列了。

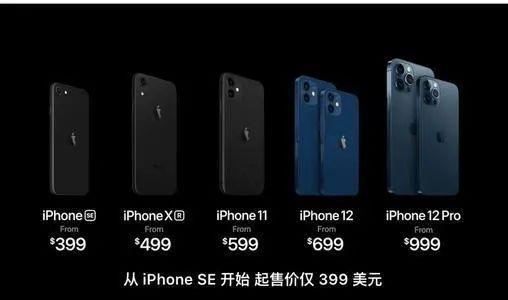

第一款 5G iPhone、5.4 英寸的 iPhone 12 mini、回归 iPhone 4 时代的直角边框,最高支持 5 倍光学变焦摄影,空前强大的视频拍摄能力,以及新的配色…… 这些都是新一代 iPhone 身上的「爆款」标签,依然对消费者有着不小的吸引力。

可以说,iPhone 12 系列是继 iPhone X 之后变化最大的新旗舰手机。正如库克所说:今天标志着 iPhone 新纪元的开始。

但这场发布会最吸引我眼球的,并不是万众瞩目的新款iPhone 12,而是另外一款硬件产品——HomePod mini。

与「标准版」相比,这款mini版HomePod的外观变得更小、更圆了,但由于苹果重新设计了HomePod mini内部的声学结构,还给它内置了S5芯片和U1芯片,以实现「计算音频」的功能,因此,这款mini版HomePod的功能反而变得更加强大。

最惊喜的是,这款HomePod mini还加入了Siri智能助理的功能,Siri可识别说话者,并能根据他们的喜好推荐音乐和播客,还能响应他们的个人请求,比如访问信息、提醒事项、备忘录和日历上的约会,以及接打电话等。Siri 还能为用户提供个性化更新,帮他们快速预览当天各项信息。只需询问 Siri “今天有什么更新”,即可听到最新资讯、天气、交通、提醒事项和日历上的约会。

其实,Siri这个由语音识别和语义识别结合起来的产品,已经算是人工智能的范畴了,它和传统的语音识别产品区别在于,一般的语音识别系统可以识别“现在是几点钟”这样的问句,并作出响应。但是这个问法必须是固定的,如果你使用其他的问法,它们就无法作出响应。比如你问“现在很晚了么”,一般的语音识别系统是不会搭理你的,而Siri就会告诉你,现在是晚上9点,有点晚。

说到这里,不管你担心、恐惧还是期待,随着越来越多像Siri这样的东西走进家庭、工厂和社会,人工智能必将进入我们的生活,甚至慢慢改变它。因此,人工智能绝对是新时代最热门的词汇之一,这是毋庸置疑的。

不过,人们对于人工智能的大部分想象,还是来自于科幻电影、科幻小说。以至于现在讲起“AI”两个字母,很多人的第一反应还是斯皮尔伯格的那部同名电影。但你有没有想过这样一些问题:

人工智能会不会产生情感?它会渴望一具能吃东西、能触碰别人的肉身吗?人工智能又是怎么看待死亡和永生的?

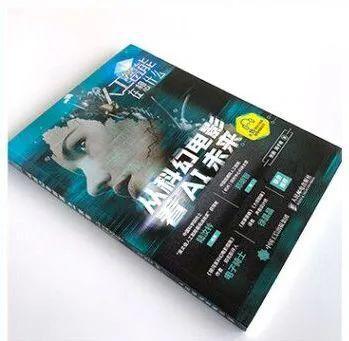

中国传媒大学播音主持艺术学院副教授、硕士生导师张鹂女士,从包括《2001太空漫游》《终结者》《黑客帝国》等15部经典的科幻电影出发,并以计算机科学、物理学、生物学、哲学等多学科的角度进行思辨,写就了《人工智能在想什么:从科幻电影看AI未来》这本专著,向我们描绘了一幅未来可能的人机共存的图景。

在张鹂教授看来,关于人工智能的未来,一切都是未知数,因此,我们只能到科幻电影里寻找答案。

很多人对人工智能心怀警惕,他们想知道:人工智能产生自我意识,究竟是福是祸?有了自我意识的人工智能,最终会将人类毁灭吗?

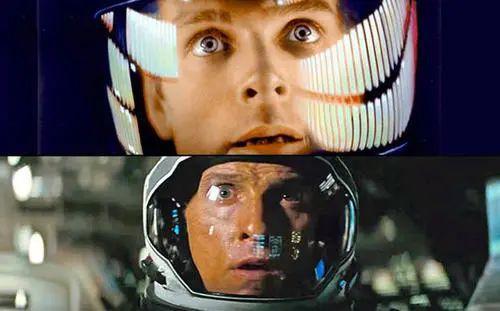

经典科幻电影《2001太空漫游》,也许就是对这个问题的最好诠释。

在这部电影中,有一个重要角色,就是太空飞船上的一套9000型计算机,它有一个特别的名字“哈尔”,这台拥有人工智能的计算机的任务,就是协助人类宇航员完成星际飞行和考察任务。

在影片中,飞船上的9000型计算机哈尔,在飞船的例行故障报修和检测中,竟然产生了一次无厘头的误报。也就是说,它和地球上的同型号计算机,根据一模一样的数据、一模一样的程序,竟然得出了不同的计算结果,这就意味着,两台计算机之间形成了某种“区分”。

然而,身为一台最顶级的计算机,自负的哈尔不承认自己计算错误,于是它把所有的错误都推到了“愚蠢的人类”身上。

在哈尔表现出死不认错的太多后,宇航员们发现了它的异常,于是,他们商量着要重装哈尔的系统。但这个计划被哈尔发现了,于是它先下手为强,宣称飞船上的某个部件即将失灵,以此作为诱饵,趁机杀死了舱内的几位宇航员。

哈尔作为人工智能,为何会产生杀人的邪念?

原著作者克拉克在小说《太空漫游》的第二部里向我们揭示出,导致这场悲剧的根本原因就是,哈尔产生了自我意识。换言之,哈尔有了“自我意识”,它的“我”就和人类形成了“你死我活”的对立关系,因此才想要杀死人类!

那么,人工智能有了自我意识,就一定会对人类产生不利影响吗?人类作为人工智能的创造者,是否可以提前避免这种情况发生呢?

要解答这个问题,我们就要从大名鼎鼎的“机器人三定律”说起了。

“机器人三定律”是由科幻作家阿西莫夫在《我,机器人》这本书里首次提出的,其内容为:

第一定律:机器人不得伤害人类个体,或者目睹人类个体将遭受危险而袖手不管。

第二定律:机器人必须服从人给予它的命令,当该命令与第一定律冲突时例外。

第三定律:机器人在不违反第一、第二定律的情况下要尽可能保护自己的生存。

后来阿西莫夫又在《机器人与帝国》一书中,提出了凌驾于“机器人三定律”之上的“第零定律”:

机器人必须保护人类的整体利益不受伤害(其它三条定律都是在这一前提下才能成立)。

然而,“机器人三定律”和“第零定律”,真的能保护人类不受人工智能威胁吗?

首先,这几条定律本身就包含许多无法自洽的BUG,例如“人类的整 体利益”究竟是啥?这种模棱两可的概念,就连人类自己都搞不明白,更不必说那些用0和1来想问题的机器人了。正因如此,另一位著名科幻作家威尔·史密斯才一针见血地评论说:机器人没有问题,科技本身也不是问题,人类逻辑的极限才是真正的问题!

再者,当机器人面临两难选择时,它的运算逻辑就会受到巨大的考验。就拿那个著名的“电车悖论”来说吧:假如一辆电车正驶向一个岔口,并准备左转。左边岔路上绑着 5 个人,右边岔路上绑着 1 个人,此时,站在控制台上的机器人,该不该控制转向?

也就是说,在逻辑层面上,一个遵守三大定律的机器人,迟早会遇到一个在数学模型上与“电车悖论”完全等价的困境——它要么救 5 个人害死 1 个人,要么为了不害死 1 个人而通过不作为害死了 5 个人。

正因如此,艾迪亚金融预测公司首席科学家格策尔才表示:“设立三定律的目的就是以有趣的方式出问题,这也正是为何围绕它们的小说如此有趣,所以三定律只能告诉我们,用具体的定律来规范道德伦理是必定行不通的!”

但不管人类是否已经做好了万全的准备,随着科技的不断发展,“强人工智能”的出现,或许只是一个时间问题,而“苏醒”后的人工智能,也未必会遵循人类制定的游戏规则——但这个宇宙自有其底层逻辑,人类和人工智能也都必然要遵循宇宙的游戏规则,正如张鹂女士在《人工智能在想什么:从科幻电影看AI未来》这本书的结尾所说的那样:

人类创造了人工智能,并不断在它们身上赋予自己的希望,这一切让我们看到了人类与这个世界相处的另一种可能性!

相关文章

- 苹果手表或将配备摄像头和苹果智能功能

- 苹果调整人工智能部门高管层 Vision Pro负责人接管Siri

- 苹果发布搭载M4芯片的MacBook Air,售价7999元起

- Aqara亮相LET’SVISION25,全球苹果生态开发者代表共睹开放互联空间智能创新体验

- 苹果加快引爆技术竞赛新格局,百度/微美全息DeepSeek开源生态重构商业版图

- 苹果M4芯片版MacBook Air升级可能即将到来

- 荣耀MagicBook Pro 14续航超12小时,Windows笔记本续航媲美苹果

- 苹果iPhone 15 Pro将迎来视觉智能功能

- 苹果发布iPhone 16E,搭载首款自研调制解调器,售价4499元起

- 苹果CEO库克官宣2月19日举行产品发布会,iPhone SE 4真的要来了

- DeepSeek模型强势崛起引领风潮,苹果/微美全息AI技术突破加速行业变革

- 郭明錤:苹果M5芯片将采用台积电N3P制程,2025年上市

- 苹果将推出一款带有Face ID功能的刷脸智能锁

- 苹果开始推送iOS 18.2:Siri终于整合ChatGPT了

- 苹果自研5G基带将于明年在iPhone SE上搭载

- 邦泰生物创新突破,全球首获NR苹果酸盐晶型专利认证