麻省理工学院林肯实验室开发人工智能展示其决策过程

2018-12-28 11:08:17爱云资讯1159

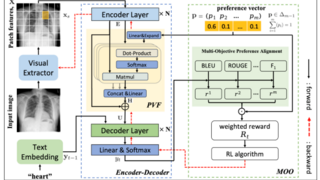

在麻省理工学院林肯实验室智能与决策技术小组发表的一篇论文中(“ 设计的透明度:弥合视觉推理中的性能与可解释性之间的差距 ”)今年夏天在计算机视觉和模式识别会议(CVPR)上发表,研究人员描述了执行“人类”推理以回答有关世界的问题的系统 - 即图像的内容。

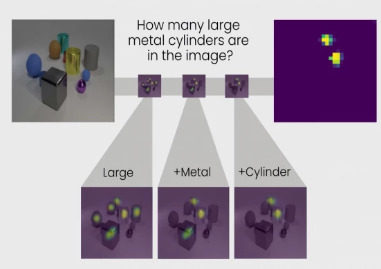

神经网络 - 被称为透明度设计网络(TbD-net) - 用热图描绘其视觉分析。在对照片进行解读时,它会以明亮,易于识别的颜色(用于研究人员的说法中的“注意力掩模”)突出显示感兴趣的项目,这些颜色代表模块的输出,或专门用于执行特定任务的小型神经网络。

麻省理工学院新闻报道称,“就像工人下线一样,每个模块都会在模块出现之前建立最终产生最终正确答案的模块。” “作为一个整体,TbD-net利用一种AI技术来解释人类语言问题并将这些句子分解为子任务,然后是多种计算机视觉AI技术来解释图像。”

那么它怎么能回答像“大金属立方体是什么颜色”这样的问题呢?首先,模块会隔离大对象。然后第二个模块将识别哪些对象是金属。第三个将查找符合先前标准的立方体,最后,第四个将确定对象的颜色。

在涉及85,000个训练图像和850,000个问题的测试中,TbD-net的准确度为98.7%,优于其他基于神经模块网络的方法。更重要的是,它实现了最先进的性能 - 99.1%的准确度 - 部分归功于它产生的热图插图,这使得研究人员可以非常精确地调整它以进行后续测试。

这篇论文的作者认为,对神经网络推理的这种洞察力可能对建立用户信任大有帮助。

最近几个月,许多公司,政府机构和独立研究人员试图解决人工智能中所谓的“黑匣子”问题 - 一些人工智能系统的不透明性 - 并取得了不同程度的成功。

2017年,美国国防高级研究计划局启动了DARPA XAI计划,旨在生产“玻璃盒”模型,在不牺牲性能的情况下轻松理解。今年8月,IBM的科学家们提出了一份人工智能的“情况说明书”,它将提供有关模型漏洞,偏见,对抗性攻击易感性和其他特征的信息。微软,IBM,埃森哲和Facebook开发了自动化工具来检测和减轻AI算法中的偏差。

“人工智能系统具有改变我们生活和工作方式的巨大潜力...... [但]这些[透明度]问题必须得到解决才能让人工智能服务得到信任,”IBM研究院和联合会的AI基金会负责人Aleksandra Mojsilovic说道。 8月份接受VentureBeat采访时,人工智能科学促进社会福利计划。

相关文章

- 实验室安全管理成焦点,汉威科技赋能实验室安全升级

- 华为擎云 L420x快不止一点,登顶赛宝实验室自主创新笔记本性能榜

- DEKRA德凯成为中国首家工业控制系统网络安全IEC 62443-2-1 CBTL认证实验室

- 广和通与实丰文化达成战略合作,共建AI产品联合实验室

- 中国移动人工智能可信监管治理北京市重点实验室亮相中关村论坛

- 勤哲Excel服务器自动生成实验室数据采集与报表管理系统

- 晶泰科技与阿联酋王室达成高额合作,机器人自动化实验室出海实现突破

- CTI华测检测半导体检测及分析中心实验室完成全面升级

- DeepSeek模型在“裸奔” 腾云悦智安全实验室Ollama安全防护保姆级教程来了!

- 华为阅读与中国传媒大学重点实验室强强联合,技术赋能带来精品音色3.0

- “掌上实验室”革新文物保护:艾尼提便携式显微镜助力实现现场精准修复

- 唯一!云从科技作为民营企业入选川渝共建重点实验室建设

- 药企非临床实验室迈向智能合规管理:三维天地GLP-LIMS提升效率与合规性

- OpenAI前首席技术官米拉·穆拉蒂官宣创业, 成立思维机器实验室

- 腾讯云日志服务CLS×科恩实验室联合发布:威胁IP自动检测告警,规避网络安全风险

- 快手与杜比实验室达成深度合作 短视频领域首家全链路支持“杜比视界”