谷歌Live Transcribe应用帮助听障人士“对话”

2019-04-23 15:31:33爱云资讯658

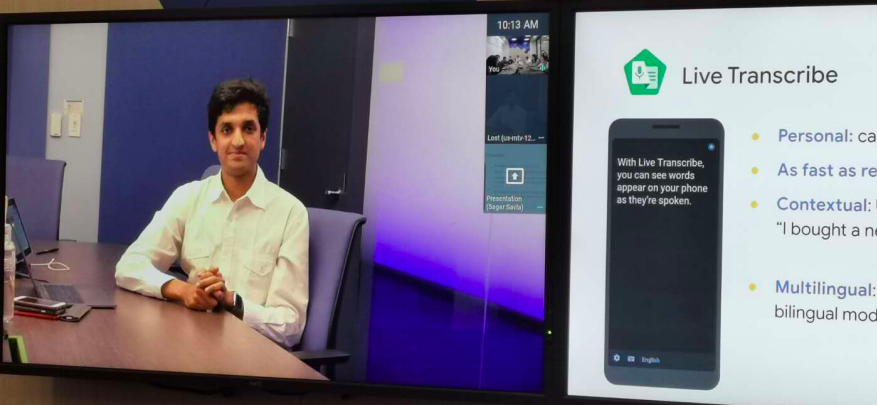

4月23日消息,Google人工智能研究团队的高级产品经理Sagar Savla向包括环球科技在内的媒体介绍了一款基于Android系统的应用程序—— Live Transcribe,即通过将自动字幕技术融入日常会话,从而减少现实世界中的对话障碍。

据Sagar Salva介绍称,Live Transcribe是其团队的最新工作成果,它是一款运用自动语音识别技术将现实世界中的实时对话转录为手机屏幕上可阅读的文本的安卓应用程序。Live Transcribe能实现实时的连续转录,支持70多种语言,还可以进行快速切换的双语模式。

据世界卫生组织统计,目前全球有4.66亿人患耳聋或听力障碍,到2050年,这个数字预计将增加到9亿人。

值得一提的是,以往耳聋和听障人士多依赖于人工转录服务,这些服务的费用十分昂贵,并且需要提前很久预约,因此难以在日常对话中频繁使用。Live Transcribe能够让人们只需使用手机的麦克风便可随时随地进行语音转录。

Sagar对记者表示:“该应用的自动语音识别系统分为三个部分。第一个部分是声学模型,主要辨别单词中的不同音节;第二个部分是发音模型,将辨别出来的不同音节组成实际的单词;第三部分是语言模型,会根据识别出来的单词增加适当的标点符号停顿。”

据了解,为了使Live Transcribe尽可能直观,在模式上有几种可考虑的模式:计算机、平板电脑、智能手机乃至小型投影仪,最后决定专注于智能手机模式。

对此,Sagar解释道,“我们也曾考虑可穿戴设备,但这种设备造价相对较高,普及率也远不及手机。因此,我们最终还是选择了手机为主要平台,旨在帮助更多听觉有障碍的人群。”

相关文章

- 苹果全力研发增强现实AR眼镜,谷歌/微美全息夯实领先优势开启空间交互时代!

- OpenAI拟从谷歌收购Chrome

- 谷歌最新发布Agent2Agent 协议 (A2A)

- 谷歌地图推出新工具,助力城市分析基础设施与交通状况

- 亚马逊首款量子计算芯片Ocelot亮相,微软/谷歌/微美全息竞逐加速量子行业成熟

- 阿里开源模型万相2.1引爆视频赛道!谷歌/微美全息加入全模态AI开源新时代!

- 谷歌公布2025年I/O开发者大会日期,定档5月20日

- 三星与谷歌联手开发AR眼镜,Meta/微美全息硬件先行共绘XR未来蓝图

- 谷歌量子芯片重磅登场掀热潮,微美全息持续打造量子“芯”质生产力

- Meta携手卡梅隆共铸3D沉浸世界,谷歌/微美全息创新引领全息虚拟新纪元

- 抢先OpenAI Sora谷歌新推Veo模型,亚马逊/微美全息加入AI视频生成竞赛引关注

- 谷歌DeepMind发布Gemini 2.0人工智能模型

- 2025年AI Agent商用蓄势待发,微软/谷歌/微美全息纷纷入局重塑AI全产业链

- 谷歌发布突破性量子计算芯片Willow:五分钟完成超算10的25次方年的计算

- 预报天气更快、更准确!谷歌发布AI天气预测模型GenCast

- 谷歌文生视频模型Veo私人预览版在Vertex AI平台上线