盘点2018年计算机视觉领域技术突破

2019-01-04 16:27:01AI云资讯1104

回顾2018年,是属于人工智能的一年,不论是Google、Facebook、Intel、阿里巴巴等通过产业布局进入人工智能领域的互联网企业,亦或如旷视科技Face++、极链科技Video++、优必选科技这样直接以人工智能起家的原生技术企业,都将AI注入到每个角落,掀起了一轮又一轮的技术高潮。

因而,除了NLP研究突破接连不断,CV领域同样精彩纷呈,伴随着各式各样落地应用如此接近人们的生活,技术也变得越发成熟。本文整理了在2018年,在CV技术领域取得的最主要的一些重大技术突破。

BigGAN发布

Ian Goodfellow在2014年设计了GAN,在之后的几年中,围绕这个概念产生了多种多样的应用程序。

其中,在ICLR 2019论文中出现的BigGAN,同样是一个GAN,只不过更强大,是拥有了更聪明的课程学习技巧的GAN,由它训练生成的图像连它自己都分辨不出真假,因为除非拿显微镜看,否则将无法判断该图像是否有任何问题,因而,它更被誉为史上最强的图像生成器。

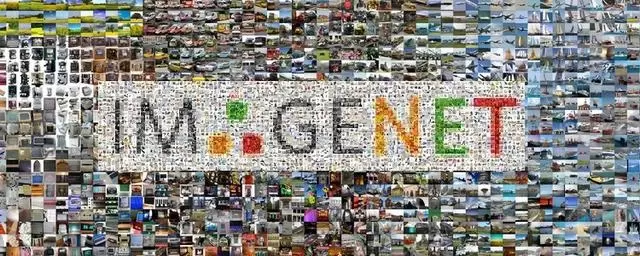

在计算机图像研究史上,BigGAN带来的突破是划时代的,比如在ImageNet上进行128×128分辨率的训练后,它的IS得分能达到166.3,是之前最佳得分52.52分3倍;除了搞定128×128小图之外,BigGAN还能直接在256×256、512×512的ImageNet数据上训练,生成更让人信服的样本。

英伟达Video-to-Video Synthesis

英伟达在2018年的收获颇丰,他们的研究焦点从标准的监督学习转向更具挑战性的机器学习,如半监督学习,领域适应,主动学习和生成模型等。其中,由英伟达在2018年末发布的最大成果之一便是视频到视频生成(Video-to-Video synthesis),它通过精心设计的发生器、鉴别器网络以及时空对抗物镜,合成高分辨率、照片级真实、时间一致的视频,实现了让AI更具物理意识,更强大,并能够推广到新的和看不见的更多场景。

因而,Video-to-Video Synthesis也被看作是在过去几年中,视频领域的一次重大突破,毕竟从静态框架转换为动态框架的难度是很大的,但机器训练却在尽量模拟预测视频将会发生的情景,通过给定的输入视频学习映射函数,产生仿真度极高的视频内容。

Fast.ai18分钟训练ImageNet

在普遍认知还停留在需要大量计算资源来执行适当的深度学习任务时,Fast.ai通过使用16个公共AWS云实例,每个配备8个NVIDIA V100 GPU,运行fast.ai和PyTorch,用18分钟在ImageNet上将图像分类模型训练到了93%的准确率,刷新了一个新的速度记录。

这是一个令人惊喜的结果,尤其在公共基础设施上训练ImageNet能达到这种准确性,并且比其专有TPU Pod群集上的谷歌DAWNBench记录快40%,运行成本仅约为40美元。这意味着一个关键的里程碑出现了,几乎所有人都可以在一个相当大的数据集上训练大规模神经网络。

除了这些重要的节点之外,2018年的计算机视觉技术也部署更多方面,不论是亚马逊发布Rekognition将计算机视觉置于开发人员、微软为OneDrive和SharePoint推出了新的AI服务、Google相册让我们的记忆变得可搜索、还是每个场景下都正在逐渐普及的AI人脸识别等等,计算机视觉正在逐步渗透到我们生活的每个部分。

最后,最值得注意的是,计算机视觉的市场增长几乎与其技术能力的增长是一样快的,预计到 2025年,计算机视觉领域会带来超过262亿美元的收益,因而在人工智能的未来里,计算机视觉一定是最有力的表现形式,并将随处可见。

相关文章

- 合合信息技术专家受邀出席RACV2022,探索计算机视觉与图形学未来增量

- 特斯联实现计算机视觉科研突破,多项研究成果入选CVPR、TPAMI等国际顶会顶刊

- 格灵深瞳专注计算机视觉领域,自主研发核心算法

- 百分点科技:基于计算机视觉的语义分割技术如何在水域监控上发挥作用

- 百分点感知智能实验室:计算机视觉理论和应用研究

- 计算机视觉产业知识产权联盟成立,美图公司携手行业伙伴助力产业升级

- 中兴通讯斩获全球计算机视觉顶级会议CVPR 2021多项荣誉

- 开发AI神经网络用于打假 阿里安全获计算机视觉顶会ECCV2020竞赛冠军

- 计算机视觉助力人工智能产业快速发展

- 计算机视觉:领跑人工智能产业

- 发售当天售罄!在小米CC9火爆背后隐藏的计算机视觉算法

- Forrester发布中国计算机视觉公有云平台能力报告:百度智能云最领先

- 眼控科技亮相全球顶级计算机视觉盛会ICCV

- 旷视致力于以先进的计算机视觉算法赋能物联网设备

- Uber拟收购计算机视觉创企Mighty AI,拓展自动驾驶汽车业务

- 拨开迷离光影 中国企业在计算机视觉领域突破加快