优云数智UMCloud CTO王璞:智能平台加速AI落地

2018-11-24 11:09:08爱云资讯791

如果说大数据是企业的矿藏,那么AI就是从矿藏提炼价值的工具。通过成熟的AI做初步推断,过滤前期繁琐、重复性的人工,不仅提升工作效率,也有效释放资源。

在11月14日-15日,英特尔于北京举办的AIDC人工智能大会上,UCloud旗下专业私有云服务商优云数智UMCloudCTO王璞发表《智能化基础平台,加速企业AI布局》主题演讲。他表示,AI的快速发展与AI的自主推断、训练有很大关系,需要基础云平台提供对AI应用运行部署的原生云环境支撑。

AI应用:便捷背后的复杂

不论智能消费单品亦或行业应用,语音识别、影像识别等火热的AI,正推动一场智慧变革,在各个实际场景得以应用。行业变革,资本趋热, AI迈入发展快车道。

结合时下的AI企业,大致可分为:其一,作为某应用的AI服务商,专业服务于其他需要用到AI应用的企业;其二,应用于自身业务发展需要的企业,选择自主AI,该类型企业大多为私有云部署;其三,拥有丰富AI的公有云服务商。

自身无AI能力的企业,要用AI服务,没问题,可直接在线调用第三方AI服务接口;拥有AI能力的企业,在自身AI应用中出现某些失误,也没问题,因为AI算法本身就需要不断的优化。在客户应用中,不论接口调用或自主算法优化,背后都需要强大的基础资源支撑。

AI原力:基础平台资源

一切原力都来自“地下”即基础平台。王璞表示,AI人工智能的发展主要围绕三大基础——算力、计算、大数据。

诸多企业欲推出自主AI,他们具备足量的算法开发能力,但有时往往缺乏计算、存储资源的底层运维能力。UCloud & 优云数智UMCloud UAI作为应用于企业的一站式AI服务产品,将关注点落在了AI场景的算力及大数据需求,从基础平台协助企业AI快速落地。

助力企业AI一体化的UAI平台

前段时间,伴随AI大热,GPU成本也应声大涨,甚至后续出现企业即便高价也得不到供货的局面。UAI协助企业统一资源调度管理,分配训练、推断的优先级,增加使用效率。面对有限的计算资源,UAI利用容器化实现分布式训练与推断服务,有效满足企业在AI场景下的大数据训练与高频率推断需求。

例如AI先决条件是需要有数据、丰富准确地对接海量数据。当数据量过大,基础计算无法满足计算需求时,UAI通过容器化实现自动打包训练镜像,实现现有GPU计算资源的共享及挖掘。由此拥有GPU服务器、且有AI训练业务的企业,借助UAI平台,不仅能帮助企业有效管理GPU,也能实现企业AI应用的实际落地。

同时UAI还协助AI企业在基础资源的按需拓展。当数据流量不大,企业在现有资源完成AI训练及推断;当用户访问量上升,数据流量增加,UAI自动实现计算资源扩展。

UAI AI Inference + Intel Caffe 解决方案

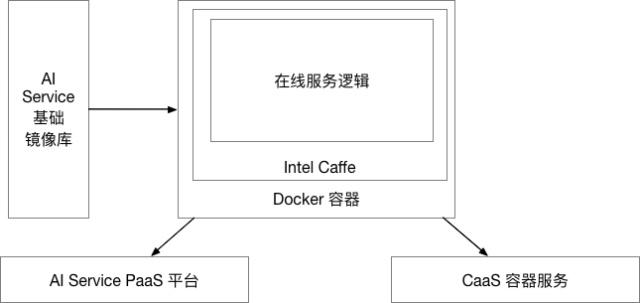

结合行业用户成本考量, UCloud & 优云数智UMCloud 亦联合伙伴推出高性价比AI方案,例如基于Intel Caffe版本和Intel Xeon CPU提供结合Intel Caffe和AI Inference系统的高性能CPU 在线服务解决方案。不仅让行业客户享受AI快速推断,也有效降低其应用成本。

AI价值:融入应用

AI的快速诊断在未来极其重要,如未来的无人驾驶汽车,如何做到自动避障即时事故,就要求AI的极速推断。再如当下呼吁的边缘计算,无限靠近应用——即消除信息冗余,快速AI判断。其实边缘计算可理解为成熟AI算法在前端设备或服务器的前置。

对此,王璞表示,UAI的一个特色便是计算下沉,将用户AI计算节点和存储节点在一起,资源调用直接利用本地磁盘传输,避免网络带宽限制带来数据I/O速度。其实,不同于边缘计算的算法前置,UAI的计算下沉适用包括公有云、私有云等拥有集群的各个场景,将在基础层面提升AI速率。

AI作为功能强大的应用,本身需要跟其它诸多功能及企业业务相配合,才能真正提升行业工作效率,适用于现实场景。UCloud & 优云数智UMCloud UAI结合自身提供的数据湖解决方案,实现计算下沉,配合其他业务,提升训练数据存储和流转的效率,从而更好服务于行业。

随着现实场景诸多案例落地,AI应用已被视为大数据时代重要变革,然而基于安全、稳定性考虑,尤其在诸多行业应用中,AI应用还需要接受更多的验证及检测,UCloud旗下专业私有云服务商优云数智UMCloud借助UAI将为更多私有云服务商的AI落地提供服务。